AIが「秘密を守れる」ということの価値

公開日:2026.05.01

※この記事は、『2026年2月1日』に公開した内容をもとに掲載しています。

今のAIサービスは様々な側面で、秘密を守り切ることができません。

ここでいう「秘密」は、①個人情報、②企業機密(顧客、財務、研究、ソースコード、M&A等)、③AIが要約・抽出した“結論そのもの”を含みます。

エンタープライズ企業では、まだまだAI活用は十分に進んでいません。強大であるがゆえに、守るべきものもあり、強いガバナンスのもとでAI活用の推進は非常に難易度が高いです。場合によっては、自社のアセット保護のためにAIを活用しないという方向に進むケースもあります。

ChatGPTやGemini、Claudeのようなフロンティアモデルではエンタープライズプランが用意されており、自社データの学習利用はされないようになっています。しかし、データ(会話履歴や入力ファイル)はサービス上に格納され、サービス提供者はアクセス可能です。ポリシーレベルではデータ保護を保証していますが、本当に自社のデータは利用されていないと断言することは難しいでしょう。

企業としてはポリシーを持っていても、従業員全員が徹底しきれるかといえば、そうとは限りません。内部攻撃の対象になることもあるでしょう。または、サービス提供者が誤って公開可能にしてしまうかもしれません。CLOUD Actなどによる政府からの介入リスクもあります。

また最先端の生成AIプレイヤーの最大の課題はデータの不足です。特に、産業データは通常では手に入れることができず、今後のモデルの性能を飛躍させるうえで、フロンティアモデルプレイヤーからすると喉から手が出るほど欲しているものです。それがポリシーを破るだけでアクセス可能だとしたとき、どうなるでしょうか。

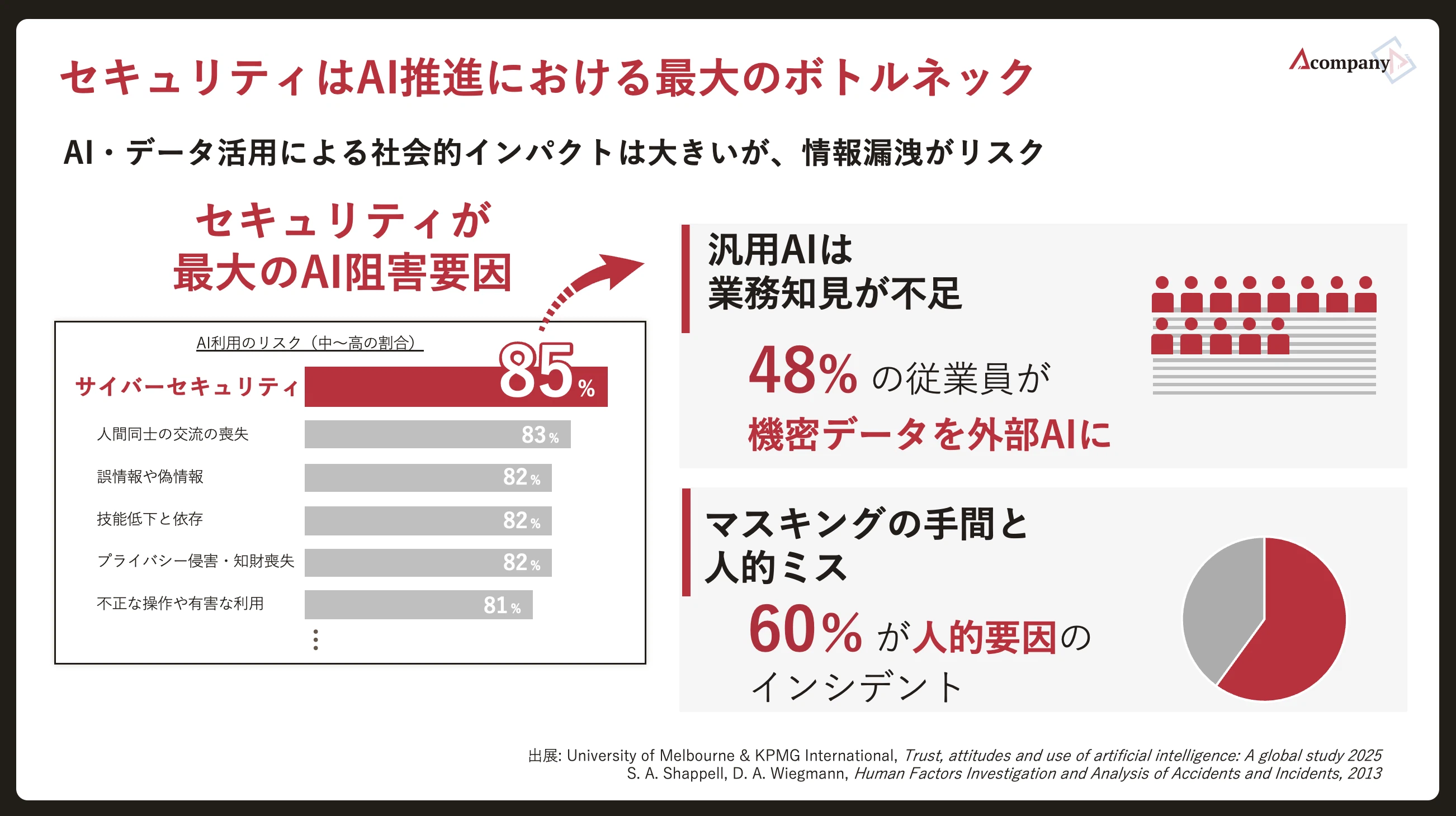

このような懸念を持つため、簡易な用途ではAIを活用しても本格的な活用には進めないというケースが増えています。KPMGの調査ではAI利用において、サイバーセキュリティリスク、知的財産の漏洩は8割以上で懸念となっています。

さらに重要なのは”現場の実態”です。生成AIを利用している従業員の約半数(48〜49%)が、企業の財務情報、営業情報、顧客情報などの機密データや著作権のある資料を公開AIツールにアップロードしたことがあると回答しています。これらの行為は「不適切で慢心的(complacent)な利用」として報告され、企業のポリシーに違反する形で行われていることが多い点が非常に大きなポイントです。

これらの一つの解決策がオンプレ環境でAIモデルを動かすというアプローチです。しかし、使い勝手はアップデートを繰り返すサービス型に劣る、もしくは自社のためだけに同等の作りこみを行うこともできますが、スケールメリットがないので当然コストは非常に高くなります。

この問題を超えたとしても、運用を担当する技術者や委託会社がデータにアクセスできてしまうという問題もあります。特にAIがアクセスできるデータに対しては、簡単に情報を取得できてしまうという側面があるため、これまで以上に難しい問題となります。

例えば、私が利用しているChatGPTに「これまでの会話から重要性や機密性が高い情報を抽出して、教えて」と指示しただけで、様々な角度の情報を持っていることを確認できました。これをシステム管理者が実行したら、一瞬でいろいろなことがわかりそうですよね。つまり問題は「AIが賢いほど、情報抽出が容易になる」ことです。だから“権限者が見えてしまう設計”自体を変える必要があります。

秘密を守れるAI:「契約上の信頼」から「技術的な保証」へのシフト

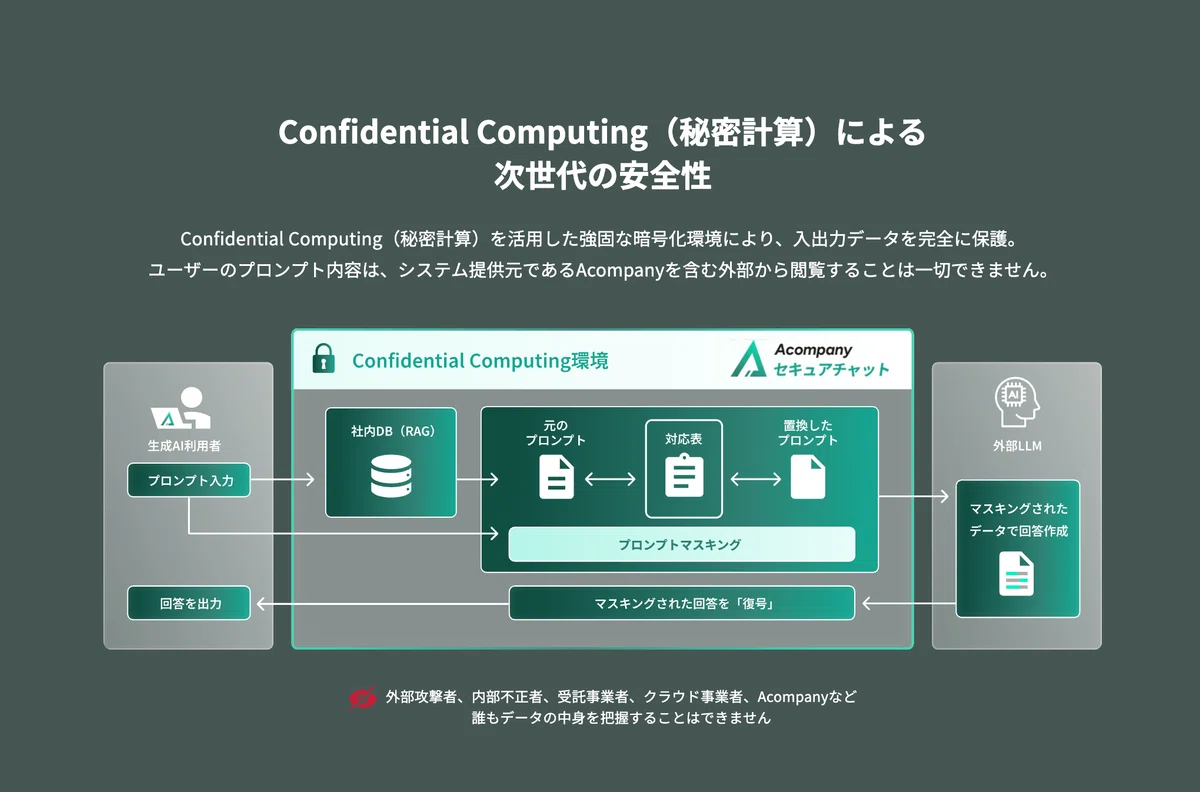

AcompanyのAI製品コンセプトは、「秘密が守れるAI」です。これをポリシーレベルではなく、技術的な保証として実現します。これを実現するための技術がプライバシーテックであり、特にConfidential Computing(ハードウェア型秘密計算)を中核にしています。

Confidential Computingは、データを「保存中」「通信中」だけでなく、「処理中(メモリ上)」も守るための仕組みです。CPUの中に隔離された実行領域(TEE)を作り、その中でだけAIを動かします。この領域内では、OSやクラウド管理者でさえアクセスできません。

プロンプトや添付データはTEEの中でだけ復号され、推論結果は再び暗号化されて返ります。この仕組みにより「アクセスしない」というポリシーではなく、「アクセスできない」というアーキテクチャで秘密が守られます。

この技術の概要や動向は前回の記事で紹介していますが、以下の通り実用化が加速しています。

弊社が2020年にこの領域で事業を開始したときは、知っている人のほとんどいないニッチな技術でした 。しかし、今やAI時代のデータ利活用における「必須のインフラ」になるべく、急激な普及が進み出しています。まさに今勝負すべき、Why Nowを持つ領域になっています。

特に、ハードウェア型秘密計算であるConfidential Computingが今、AIセキュリティのデファクトスタンダードの地位を確立しつつあります。ガートナー社が発表した「2026年の戦略的テクノロジーのトップ・トレンド」にも選出され、2029年までに信頼されていないインフラ上での業務の75%以上が秘密計算で保護されると予測されています 。

この予測を裏付けるように、すでに実用化の波はBigTechを中心に大規模に進んでいます。Appleによる「Apple Intelligence」への大規模採用 や、Googleによるオンプレミス環境向け「Gemini」での標準的な採用 など、もはや秘密計算は特別な技術ではなく、AIを安全に届けるための「標準的なインフラ」となりつつあります。

しかしながら、Confidential Computingを核にしながらも実際に「秘密を守れるAI」を実現するためには入力データの取り扱い、ログ、権限設計、監査といった解かなければならない運用上の問題も様々存在します。そこにその他のプライバシーテック技術を活用しています。

世界最先端での「秘密を守れるAI」技術の開発と製品化

Acompanyは、このような世界最先端での技術的な挑戦と、それらの製品化に取り組んでいます。直近では、秘密を守れるAI製品ブランドとして「Confidential AI Suite」を発表しました。

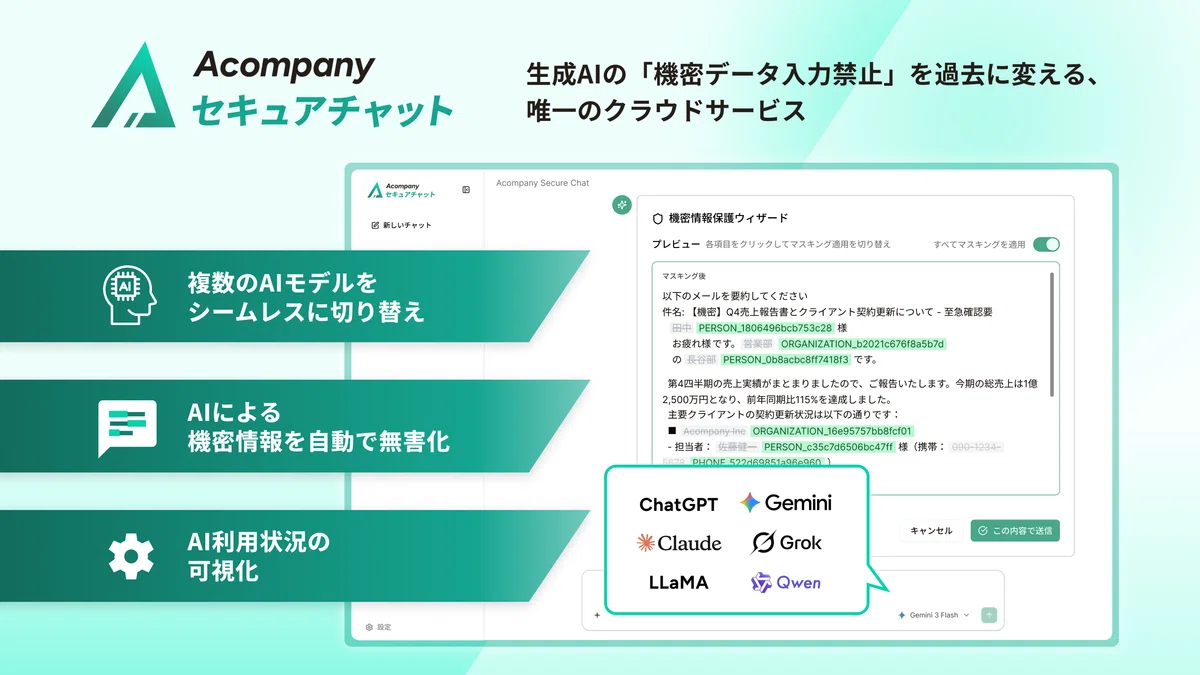

第一弾製品として「Acompany セキュアチャット」をリリースしました。このAI SaaSは実際にConfidential Computing上で稼働し、サービス提供されています。

▼サービスデモ動画

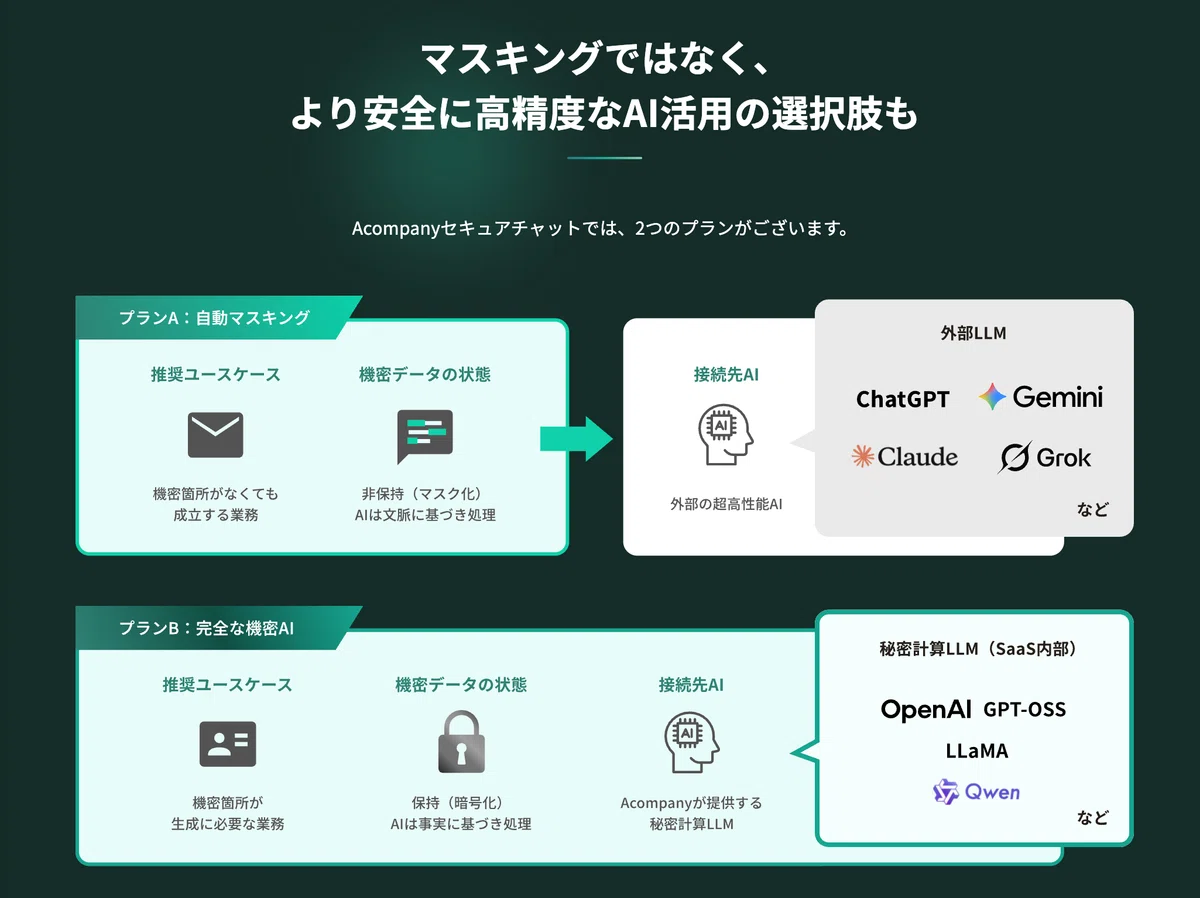

「Acompany セキュアチャット」では、最高性能の外部LLMを安全に利用するために送信する前のプロンプト無害化機能を標準にしています。加えて、多少モデル性能を落としてでも完全な安全性を実現するためにConfidential Computing上でLLMを動かして使うことも可能になっています。

「Acompany セキュアチャット」は、大規模なエンタープライズ企業からの引き合い/利用開始も進んでいます。これまでのチャットサービスが埋められていなかった価値を提供できる手応えを感じています。

当然、Acompanyとしてはこのチャットサービスは「Confidential AI Suite」の第一弾なのでさらなる製品展開を控えています。「秘密を守れるAI」が付加価値を出せるフィールドは非常に大きく、如何にこのチャンスを形にしていくことができるかが、とても重要であると考えています。

入力された情報は学習には使われませんが、念のため個人情報の入力はお控えください。